Zahlen lügen nicht?

Warum Mathematik menschlicher ist, als wir glauben. Ein Plädoyer für den ethischen Umgang mit Formeln und Modellen.

Eins plus eins ist zwei. In einer Welt voller „Fake News“ und subjektiver Meinungen gilt die Mathematik oft als der letzte Fels in der Brandung: objektiv, neutral, unbestechlich. Doch dieser Schein trügt. Bei einem gemeinsamen Vortrag an der Pädagogischen Hochschule Vorarlberg habe ich zusammen mit meinem Kollegen Univ. Prof. Gregor Nickel, einem Mathematikphilosophen aus Siegen, einen Blick hinter die Kulissen der scheinbaren mathematischen Wahrheit geworfen. Das Fazit: Mathematik ist ein mächtiges Werkzeug, aber sie ist nie frei von menschlichen Werten – und menschlichen Fehlern.

Wenn Brücken sich verpassen

Manchmal scheitert die Mathematik schlicht am Handwerk. Ein fast schon legendäres Beispiel für „falsch gerechnet“ ist die Hochrheinbrücke zwischen Deutschland und der Schweiz. Bekanntlich definieren die beiden Nachbarländer die Meereshöhe unterschiedlich – Deutschland bezieht sich auf die Nordsee, die Schweiz auf das Mittelmeer. Die Differenz beträgt 27 Zentimeter. Das wussten die Ingenieure. Doch leider passierte ein klassischer Vorzeichenfehler: Statt den Wert abzuziehen, wurde er addiert. Das Ergebnis: Die beiden Brückenhälften wiesen einen Höhenunterschied von 54 Zentimetern auf.

Solche Fehler sind teuer und peinlich, aber ethisch meist unproblematisch, solange „nur“ Geld und Beton betroffen sind. Dramatischer wird es, wenn blinde Technikgläubigkeit auf Menschenleben trifft. Das schwedische Kriegsschiff Vasa sank 1628 kurz nach dem Auslaufen, weil zwei Teams von Zimmerleuten unterschiedliche Maßeinheiten verwendeten – schwedische und Amsterdamer Füße. Das Schiff war schlicht asymmetrisch.

Das Modell ist nicht die Realität

Die wirkliche ethische Brisanz liegt jedoch oft nicht im Rechenfehler, sondern in der sogenannten „Modellierung“. Bevor wir rechnen, müssen wir die Welt vereinfachen. Wir müssen entscheiden: Was ist wichtig? Was lassen wir weg?

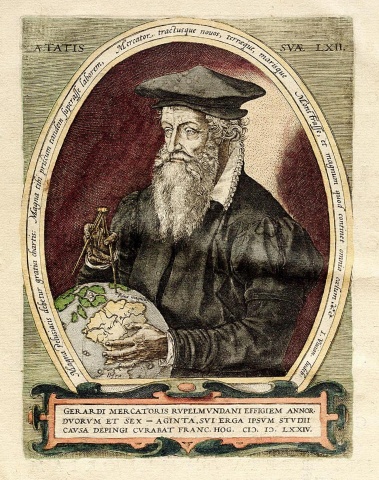

Nehmen wir unsere Weltkarten. Die meisten von uns haben das Bild der Erde im Kopf, das Gerhard Mercator im 16. Jahrhundert entwarf. Seine Karte war genial für die Seefahrt, weil sie winkeltreu ist – wer den Kurs auf der Karte einzeichnet, kommt auch in seinem Ziel an. Der Preis dafür: Die Flächen sind massiv verzerrt. Grönland wirkt auf der Karte fast so groß wie Afrika, obwohl Afrika in Wahrheit 14-mal größer ist. Ist das eine Lüge? Nein, es ist eine Entscheidung für die Navigation und gegen die Flächentreue. Problematisch wird es erst, wenn wir vergessen, dass jede Karte, jede Statistik und jeder Algorithmus auf solchen Entscheidungen beruht.

Wenn Wahrscheinlichkeit zum Urteil wird

Wie gefährlich unreflektierte Mathematik sein kann, zeigt der tragische Fall der Sally Clark. Die Britin verlor Ende der 90er Jahre zwei Babys durch plötzlichen Kindstod. Ein sogenannter statistischer Experte rechnete vor Gericht vor: Die Wahrscheinlichkeit, dass so etwas zweimal in einer Familie passiert, sei verschwindend gering (1 zu 73 Millionen). Die Schlussfolgerung der Justiz: Es musste Mord sein. Clark wurde verurteilt.

Der Fehler? Der Experte nahm an, die Todesfälle seien voneinander unabhängige Ereignisse – wie zweimaliges Würfeln. Doch in der Biologie gibt es genetische oder umweltbedingte Faktoren, die das Risiko von plötzlichem Kindstod für ein zweites Kind erhöhen. Zudem wurde die falsche Frage gestellt: Man hätte nicht fragen dürfen, wie unwahrscheinlich zwei Todesfälle sind, sondern wie wahrscheinlich im Vergleich dazu ein Doppelmord durch die Mutter ist. Mathematisch gesehen wäre der Mord nämlich noch unwahrscheinlicher gewesen. Sally Clark wurde später freigesprochen, doch sie erholte sich nie von dem Unrecht und starb ein paar Jahre später an Alkoholvergiftung. Hier wurde fehlerhafte Mathematik ohne ethisches Gespür zur Waffe.

Der Zwang zur Fehlerfreiheit

Was lernen wir daraus für unsere digitalisierte Gesellschaft, in der Algorithmen über Kreditwürdigkeit, Jobchancen und Universitäts-Rankings entscheiden?

Erstens: Wir müssen uns von der Illusion der absoluten Fehlerfreiheit verabschieden. Der Soziologe Ulrich Beck warnte schon 1986 davor, Technologien zu schaffen, die den Menschen dazu zwingen, unfehlbar zu sein – denn das sind wir nicht. Zweitens: Jedes Modell beinhaltet Wertentscheidungen. Wenn wir Universitäten ranken, entscheiden wir, ob uns Zitationen wichtiger sind als die Zufriedenheit der Studierenden. Wenn wir eine KI trainieren, entscheiden wir, mit welchen Daten wir sie füttern.

Mathematik ist keine Insel der reinen Vernunft, abgekoppelt von unseren Werten. Sie ist ein kulturelles Gut, ähnlich wie die Sprache. Und genau wie wir lernen müssen, fair und bedacht zu sprechen, müssen wir lernen, verantwortungsvoll zu rechnen. Zahlen lügen vielleicht nicht, aber sie erzählen immer nur die Geschichte, die wir sie erzählen lassen.

Kommentare